Qwen3.5 9B로 주도주 자동 분석 시스템 만들기 - 오픈소스 공개

로컬 LLM 이야기를 하면 보통 “이걸로 무엇을 할 수 있나”보다 “성능이 어디까지 나오나” 쪽으로 대화가 흐르기 쉽다. 하지만 내가 관심 있는 지점은 조금 다르다. 로컬 LLM을 실제로 어디에 붙이면 매일 반복하는 일을 줄일 수 있나가 더 중요하다.

이번에 그 관점으로 만든 작은 프로젝트를 GitHub에 공개했다.

- 프로젝트: 로컬 LLM을 활용한 일일 주도주 분석 자동화 시스템

- GitHub: https://github.com/junbit/market-leader

이 프로젝트는 매일 오전 8시에 전날 한국 주식시장(KOSPI/KOSDAQ)에서 강하게 움직인 종목과 테마를 자동으로 정리해서 이메일 리포트로 보내준다.

핵심은 단순 크롤링이 아니다. 수집한 종목과 뉴스 제목을 바탕으로 로컬에서 실행하는 qwen3.5:9b 모델이 종목별 상승 이유와 시장 흐름을 요약한다. 즉, 외부 유료 AI API에 의존하지 않고도 “어제 어떤 종목이 왜 올랐는지”를 아침마다 자동으로 받아볼 수 있게 만든 셈이다.

왜 이런 프로젝트를 만들었나

장이 끝난 뒤 강하게 오른 종목들을 다시 훑어보는 건 생각보다 시간이 꽤 든다.

- 어떤 종목이 실제로 돈이 들어오면서 오른 건지

- 테마로 묶였는지

- 뉴스상 재료가 무엇인지

- 다음 날 아침에 바로 볼 만한 종목인지

이걸 매일 수작업으로 정리하는 건 번거롭다. 그래서 조건을 명확하게 고정한 뒤, 반복 작업을 자동화하는 쪽으로 방향을 잡았다.

현재 기준 필터는 단순하다.

- 상승률 20% 이상

- 거래대금 1,000억 원 이상

- ETF/스팩 제외

즉 “그날 실제로 시장에서 존재감이 있었던 종목”만 빠르게 추리는 데 초점을 맞췄다.

이 프로젝트에서 로컬 LLM이 하는 일

이 프로젝트의 중요한 포인트는 로컬 LLM을 화려하게 쓰는 것이 아니라, 실용적인 위치에 정확히 배치했다는 점이다.

로컬 모델이 맡는 역할은 두 가지다.

- 종목별 뉴스 제목을 보고 상승 원인을 1~3문장으로 요약

- 당일 주도주와 테마를 보고 시장 전체 흐름을 짧게 정리

여기서 사용한 모델은 qwen3.5:9b다.

- 최근 많이 쓰이는 Qwen 3.5 계열 모델

- 로컬에서 굴리기 부담이 비교적 적은 9B 규모

- 짧은 뉴스 요약과 시장 흐름 정리에 충분히 실용적인 성능

대규모 모델로 긴 리포트를 쓰게 하는 방식보다, 이런 식으로 구조화된 데이터 위에 짧고 명확한 요약을 붙이는 용도가 로컬 LLM과 훨씬 잘 맞는다고 보고 있다.

현재 구현된 흐름

전체 파이프라인은 아래처럼 돌아간다.

- 네이버 금융에서 상승률 상위 종목과 테마 데이터를 수집

- 거래대금/상승률 기준으로 실제 주도주만 필터링

- Google News RSS로 종목별 관련 뉴스 수집

- Telegram 공개 채널 메시지를 보조 참고 데이터로 수집

qwen3.5:9b로컬 LLM으로 상승 원인과 시장 흐름 요약- Markdown 리포트 생성

- HTML 이메일로 변환해 Gmail SMTP로 발송

즉 이 프로젝트는 “LLM 데모”가 아니라, 스크래핑 + 필터링 + 로컬 요약 + 리포트 발송이 연결된 자동화 파이프라인에 가깝다.

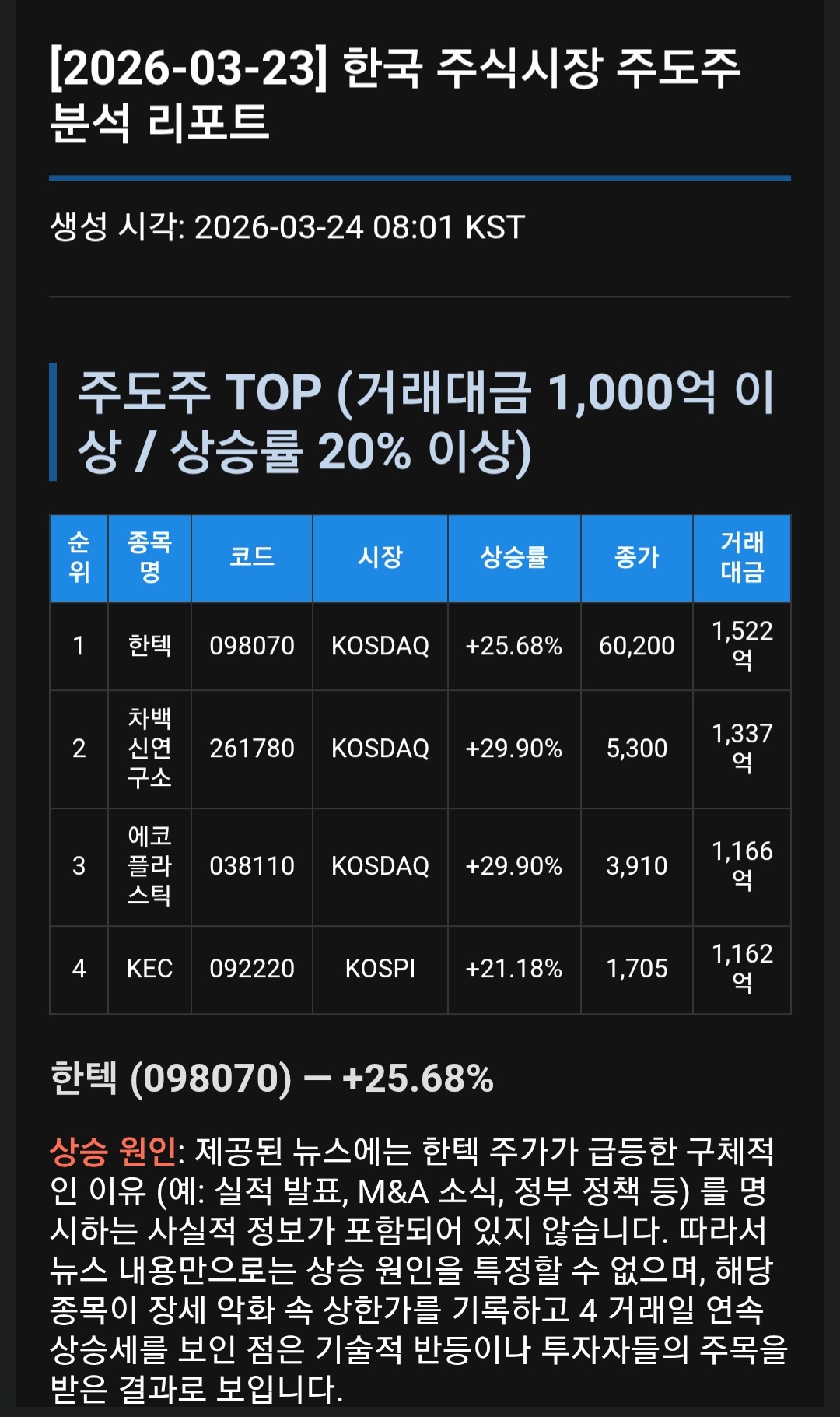

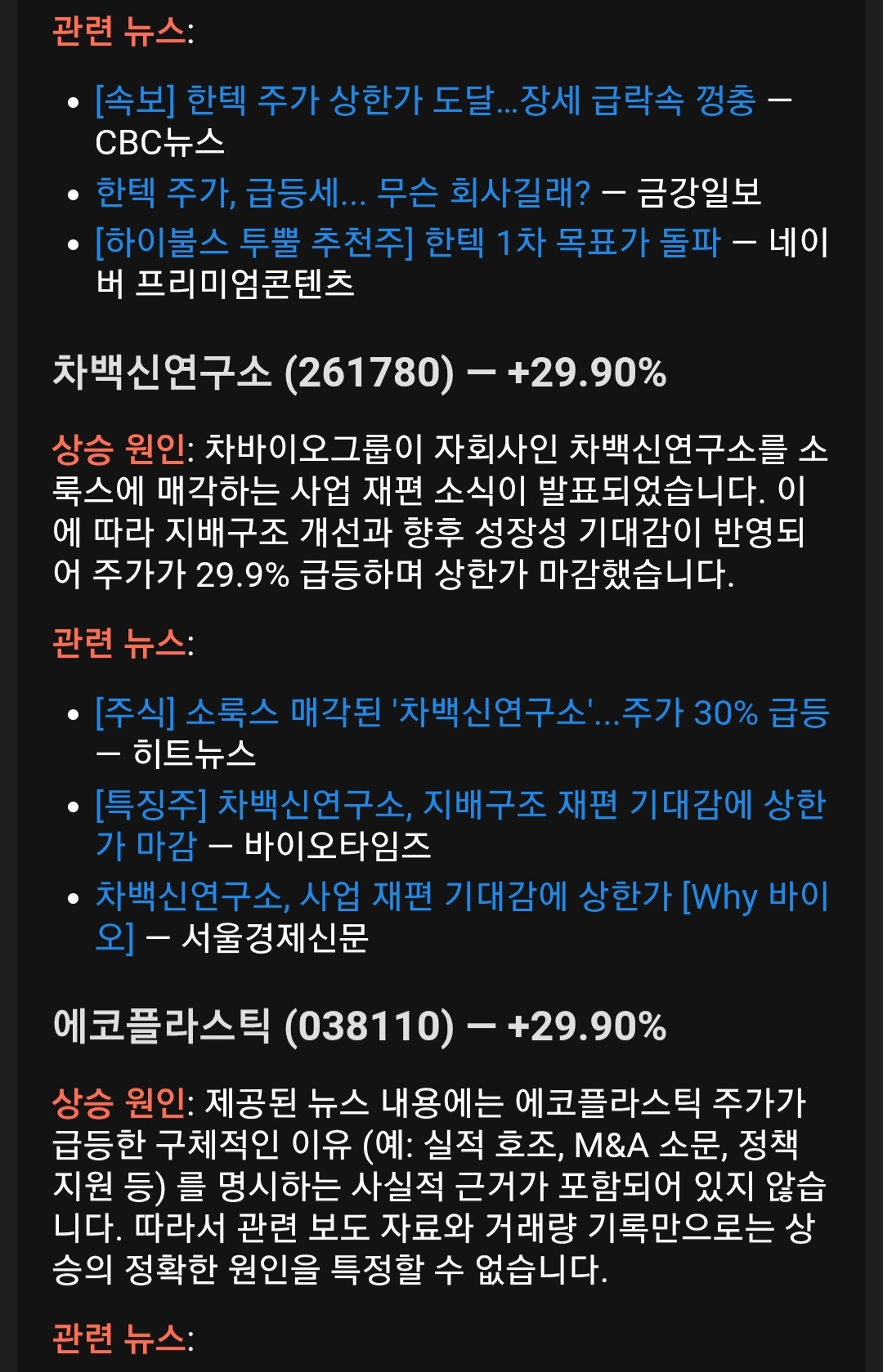

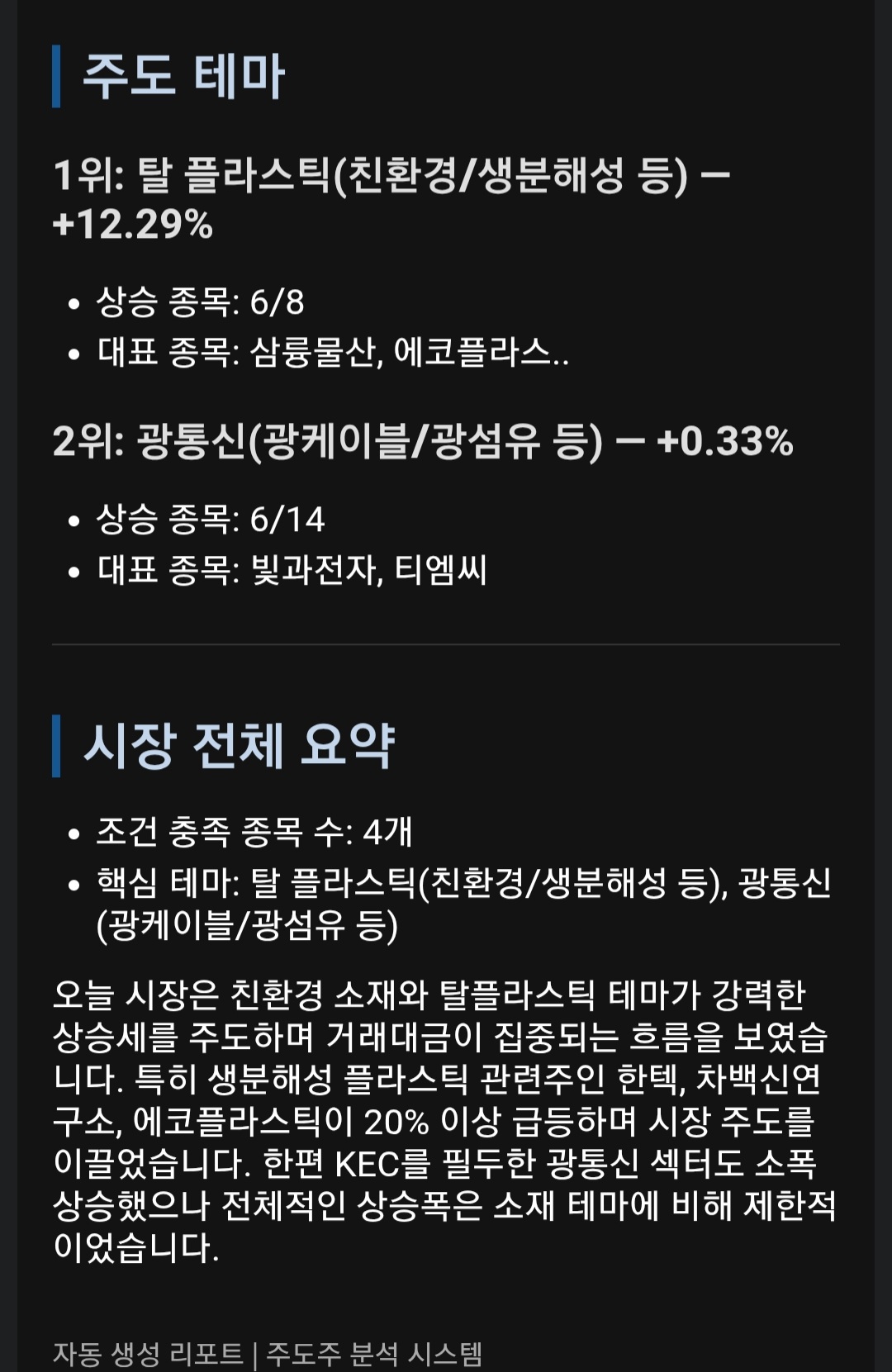

실제 리포트 예시

말로만 설명하면 감이 잘 안 올 수 있어서, 오늘 아침 내가 휴대폰으로 받아본 실제 리포트 화면을 같이 첨부해 둔다.

첫 화면에서는 주도주 TOP 표와 종목별 요약이 보이고,

이어지는 화면에서는 종목별 상승 원인과 관련 뉴스가 계속 붙는다.

마지막으로 주도 테마와 시장 전체 요약까지 한 번에 확인할 수 있다.

내가 원했던 것도 정확히 이런 형태였다. 아침에 메일 하나만 열어보면 “어제 시장에서 뭐가 강했고, 왜 올랐는지”를 짧은 시간 안에 훑을 수 있는 정도.

공개한 이유

로컬 LLM 관련 글을 쓰다 보면 벤치마크나 세팅 이야기는 많은데, 정작 실무나 개인 루틴에 붙여서 돌아가는 예시는 상대적으로 적다.

그래서 이번 프로젝트는 다음 관점에서 공개했다.

- 로컬 LLM을 실용적으로 쓰는 한 가지 예시

- 큰 모델이 아니라

qwen3.5:9b같은 경량 모델로도 충분히 자동화가 가능하다는 사례 - 유료 AI API 없이도 개인용 분석 도구를 만들 수 있다는 기록

코드는 완벽한 제품이라기보다, 실제로 내가 쓰기 위해 만든 자동화 도구에 가깝다. 하지만 오히려 그런 점 때문에 로컬 LLM을 어디에 붙여야 하는지 감을 잡는 데는 더 도움이 될 수 있다고 본다.

저장소 링크

프로젝트 저장소는 여기서 볼 수 있다.

README에는 설치 방법, 실행 방법, 환경변수 예시, 자동 실행 스크립트까지 정리해 두었다.

앞으로도 이런 식으로 로컬 LLM을 실제 자동화 파이프라인에 붙여서 쓰는 사례를 계속 쌓아볼 생각이다.